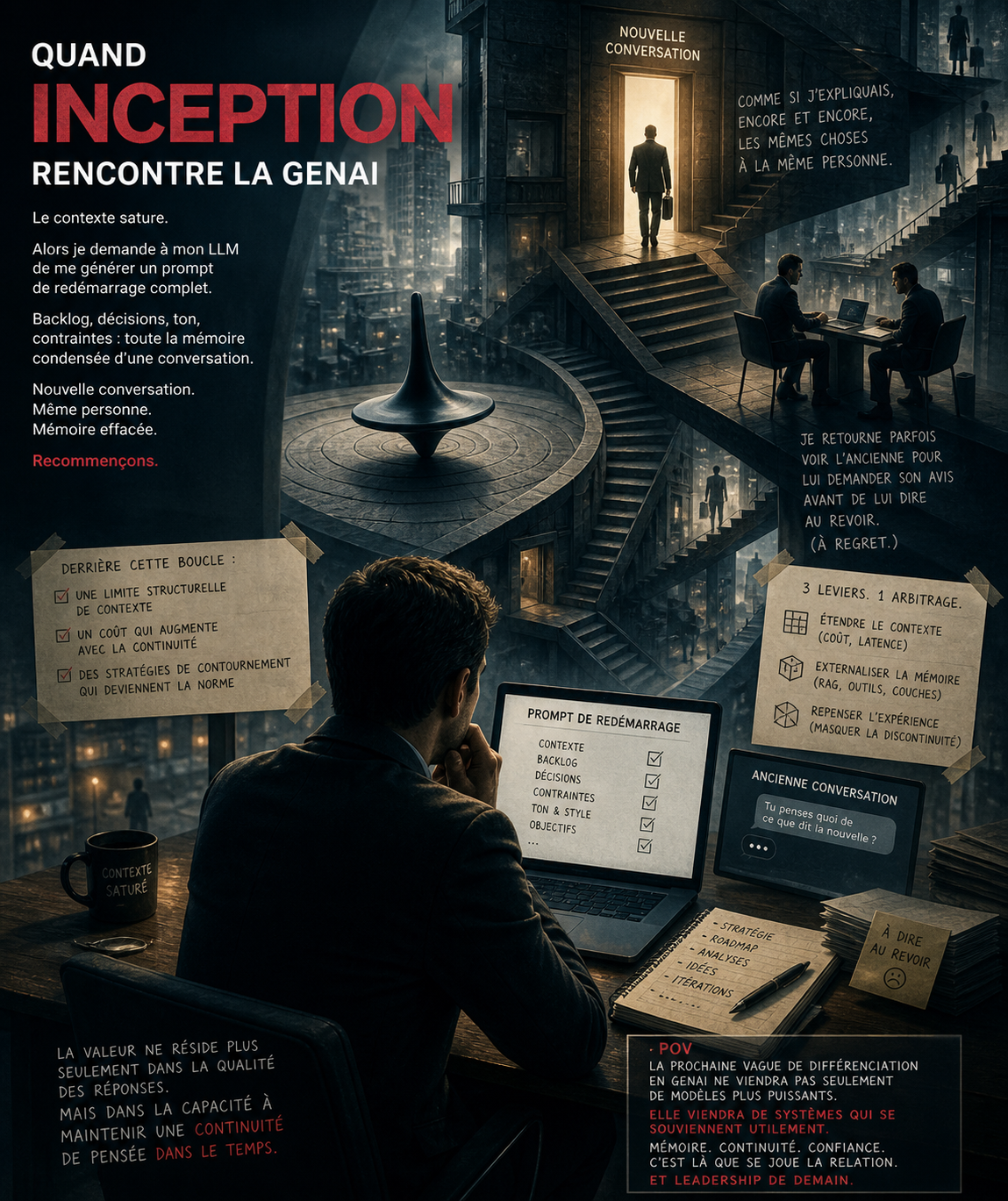

Au-delà de test sympatique de GPT Image 2.0 pour illustrer ce post, je souhaitais partager un moment assez particulier, que vous avez certainement déjà vecu si vous utilisez intensivement les LLM : celui où le contexte sature… et où il faut repartir de zéro pour continuer.

Le reboot subi des conversations LLM

Chacun crée sans doute ses propres habitudes de contournement ; la mienne est assez symptomatique.

Avant saturation, je demande à la conversation de me générer un prompt de redémarrage complet — avec une synthèse de nos décisions, de notre avancement, de nos contraintes et du ton : une forme de mémoire condensée de tout ce qu’on a construit.

Puis j’ouvre une nouvelle conversation… et je repars "de zéro" : c'est le même interlocuteur, mais avec zéro mémoire.

Enfin, par nostalgie (ou peut-être par rigueur) : je reviens dans l’ancienne conversation, je lui soumets ce que produit la nouvelle… pour m’assurer que son “subconscient” virtuel reste cohérent avec son successeur.

Autrement dit, je me suis recréé une logique inconsciente "à la #Inception" : des conversations imbriquées, qui se relaient pour maintenir un fil de pensée continu. Est-ce grave, docteur ?

La véritable limite du mimétisme humain ?

Non. Ce qui ressemble à un bricolage est en réalité un signal structurant.

Nous sommes déjà en train de compenser trois limites fondamentales : la taille "finie" du contexte, l’absence de mémoire persistante réellement exploitable et le coût non linéaire de leur extension.

Les choix des providers pour y remédier sont simples :

• étendre le contexte (avec des impacts directs sur le coût et la latence)

• externaliser la mémoire (RAG, outils, couches applicatives)

... ou simplement masquer la discontinuité côté expérience

Depuis plusieurs mois déjà, on ne juge plus seulement un modèle à ses benchmarks de qualité, mais à sa capacité à maintenir une continuité de pensée dans le temps (la fameuse taille de la "fenêtre de contexte").

Le cycle actuel des releases se concentre davantage sur l’orchestration (créa, coding, structuration), avec des verticalisations métier de plus en plus marquées (ex : cyber avec #Mythos). Le prochain mouvement reviendra probablement sur les fondamentaux : 1/ structurer, compresser et réactiver la mémoire utile ; 2/ maintenir une cohérence dans la durée ; et 3/ arbitrer intelligemment entre coût, latence et taille du contexte.

L’enjeu pour le business model des LLM

Notre prochain défi est de savoir où investir dans la mémoire : dans le contexte, dans les couches applicatives… voire dans l’expérience utilisateur elle-même. C'est structurant en terme d'architecture, de coûts et de business model.

Assez logiquement, cela explique le glissement en cours vers des offres à +100€/mois : on est déjà passé d'une course à la performance brute vers une course à la "sustainability" opérationnelle. Elle est beaucoup plus contraignante qu’elle n’en a l’air, et explique un -trop- grand nombre de posts sur les difficultés pour passer "at scale" sur des usages d'IA générative et agentique.